EDITORIAS

Alguns argumentam que a IA poderia se desenvolver e acabar com o ser humano, outros estão mais preocupados com seus impactos no dia a dia

Desde a ascensão da IA, capitaneadas principalmente pela popularidade do ChatGPT, questionamentos se a tecnologia poderia ou não substituir humanos, ou se representaria um risco para a humanidade, surgiram junto.

Ao passo que alguns argumentam que a inteligência artificial poderia se desenvolver e acabar com o ser humano, outros estão mais preocupados com seus impactos no dia a dia. No entanto, especialistas e executivos de empresas desenvolvedoras estão longe de entrar em um consenso sobre as consequências da IA.

Veja também

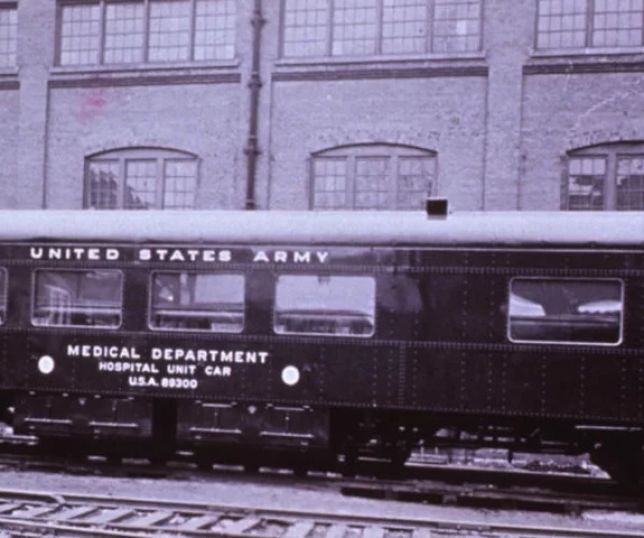

O que foi feito dos trens hospitalares que carregaram feridos na 2ª Guerra Mundial?

Mega-Sena, concurso 2.628: ninguém acerta as seis dezenas e prêmio vai a R$ 55 milhões

IA E RISCO PARA HUMANIDADE

Alguns executivos notáveis já se manifestaram sobre suas crenças acerca dos riscos da IA. Sam Altman, CEO da OpenAI, empresa desenvolvedora do ChatGPT, falou em sua turnê mundial que a tecnologia pode causar danos graves à humanidade – ou pior.

Isso incluiria a capacidade de pensar como humanos, superar o que já podemos fazer e até nos controlar.

Dario Amodei, CEO da desenvolvedora Anthropic, alertou sobre o mesmo perigo ao testemunhar no Senado estadunidense em julho.

Elon Musk foi outro: o bilionário dono da Tesla, SpaceX e do X (antigo Twitter) assinou uma carta em que especialistas e executivos do setor pediam uma pausa no desenvolvimento da tecnologia.

Também em maio, Musk disse em um evento do jornal The Wall Street Journal que a IA “tem uma probabilidade diferente de zero de aniquilar a humanidade”.

No entanto, menos de dois meses depois, em julho, o executivo lançou sua própria empresa de IA, a xAI.

IA E RISCOS DO DIA A DIA

Um grupo de cientistas contrários à ideia de que a IA arriscaria a humanidade critica quem pensa dessa forma, afirmando que esses executivos estariam criando “distrações” com hipóteses alimentadas pela ficção científica.

Para eles, as empresas e reguladores de IA deveriam focar menos no risco existencial e mais no que a tecnologia já é capaz de fazer, podendo impactar o dia a dia das pessoas. Isso inclui a capacidade de produzir desinformação, disseminar preconceitos, explorar trabalhadores e aprofundar a desigualdade.

Fotos: Reprodução

De acordo com Daniel Schoenberger, ex-advogado do Google que trabalhou na lista de princípios de IA em 2018 e agora está na Web3 Foundation, a preocupação é quanto ao domínio da tecnologia, “de a big tech se tornar uma big AI”. Assim, esse grupo pede a regulação do que a IA pode ou não fazer. A fala veio em entrevista ao The Wall Street Journal.

MEIO TERMO

Ainda, outros especialistas defendem que é a polarização entre as duas preocupações que causa distração. Segundo Max Tegmark, presidente do Future of Life Institute, ONG que fomenta debates sobre riscos ao planeta e à humanidade, as empresas têm interesse em alimentar essa divisão para evitar a regulamentação.

Curtiu? Siga o PORTAL DO ZACARIAS no Facebook, Twitter e no Instagram.

Entre no nosso Grupo de WhatApp e Telegram

Isso porque, uma vez que as pessoas estão preocupadas com o risco de a IA se desenvolver para dominar humanos, não se preocupam com o que ela já vem causando no dia a dia. E vice e versa.

Fonte: Olhar Digital.